Inteligência artificial nas campanhas eleitorais 2026

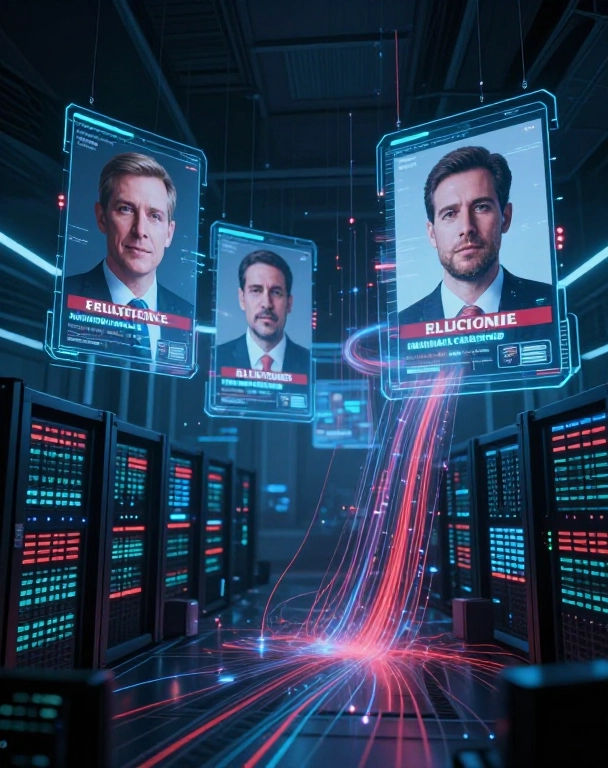

A inteligência artificial nas campanhas eleitorais tem gerado um terremoto político, com deepfakes e microsegmentação que alteram a dinâmica eleitoral. Este artigo analisa o impacto dessa tecnologia nas eleições de 2026.

Contexto histórico da IA nas campanhas eleitorais

A trajetória da inteligência artificial nas campanhas eleitorais brasileiras pode ser dividida em fases distintas, cada uma marcada por avanços tecnológicos e respostas institucionais.

| Período | Inovação principal | Impacto observado |

|---|---|---|

| 2022 | Chatbots e assistentes virtuais nas redes sociais | Primeira interação direta entre candidatos e eleitores em escala |

| 2023 | Algoritmos de recomendação de conteúdo | Personalização de mensagens políticas com base no histórico de engajamento |

| 2024 | Modelos generativos de texto e imagem | Produção automatizada de materiais de campanha, como textos persuasivos e artes visuais |

| 2025 | Plataformas de análise preditiva de voto | Modelos preditivos que estimam comportamento eleitoral com base em dados de consumo |

| 2026 | Adoção massiva de perfis de discurso automatizados | Estratégias de campanha hiperpersonalizadas que se ajustam em tempo real ao perfil de cada eleitor |

Nos primeiros anos de aplicação, as ferramentas de IA eram limitadas a respostas pré‑programadas e a segmentação básica de audiências. A partir de 2023, o acesso a modelos de linguagem de grande porte permitiu a geração automática de discursos adaptados ao tom de diferentes grupos, criando um novo padrão de comunicação que exigia menos intervenção humana.

O crescimento dessa tecnologia coincidiu com debates legislativos sobre regulamentação de conteúdo sintético. Projetos de lei foram apresentados no Congresso Nacional buscando definições claras sobre a divulgação de mensagens geradas por IA, assim como a exigência de rotulagem quando houver manipulação de áudio ou vídeo.

Parte dos partidos políticos investiu em equipes de ciência de dados para mapear perfis de eleitores em bases de dados de consumo, redes sociais e pesquisas de opinião. Essas equipes utilizaram técnicas de clustering e aprendizado de máquina para identificar micro‑públicas com temas de interesse específicos, permitindo a criação de narrativas que falavam diretamente às preocupações de cada segmento.

Esse movimento histórico, que culminou na chamada “tempestade política”, demonstra como a IA passou de uma curiosidade experimental para um elemento central da estratégia eleitoral, remodelando não só a forma de mensagem, mas também a dinâmica de disputa entre candidatos e partidos.

Deepfakes e microsegmentação como armas políticas

Os deepfakes e a microsegmentação são duas ferramentas de IA que, quando combinadas, amplificam a capacidade de manipulação política. Os deepfakes permitem a produção de vídeos e áudios sintéticos tão convincentes que podem fazer parecer que líderes políticos proclamam mensagens jamais ditas ou que eventos históricos foram reescritos. Esta tecnologia pode ser lançada tempo real durante períodos eleitorais, quando a atenção pública está voltada para debates e transmissões ao vivo.

A microsegmentação, por sua vez, utiliza algoritmos de aprendizado de máquina para analisar perfis de eleitores – idade, localização, comportamento de consumo e histórico de interações nas redes – e gerar conteúdos personalizados que falam diretamente ao medo, à esperança ou a valores específicos de cada grupo. O resultado é uma campanha que não mais se comunica em massa, mas entrega micro‑mensagens que aparecem apenas nos feeds de eleitores “de risco”, maximizando o impacto emocional e reduzindo a exposição a críticas.

Quando essas duas vertentes convergem, ocorre a chamada “armação de ondas de desinformação”. Um vídeo falsificado pode ser segmentado apenas para eleitores de uma determinada faixa etária, enquanto a mesma narrativa, adaptada em tom e visual, atinge outro segmento com foco em outra questão – por exemplo, segurança pública versus crescimento econômico. Essa estratégia cria uma realidade fragmentada, onde cada eleitor vive uma campanha distinta, dificultando a construção de um debate público unificado.

Um exemplo prático observa como plataformas de chatbots e bots de mensagens instantâneas podem distribuir áudios sintéticos de um candidato pregando uma política de segurança, mas apenas para grupos que demonstraram ansiedade sobre criminalidade. Simultaneamente, o mesmo assunto pode ser abordado em outra mensagem que realça benefícios econômicos para cidadãos de classe média, gerando um “efeito de eco” que reforça crenças pré‑existentes.

Essa fragmentação gera três consequências críticas:

- Polarização acentuada: ao receber apenas mensagens que confirmam vieses, o eleitor tende a rejeitar argumentos contrários.

- Erosão da confiança institucional: a percepção de que qualquer conteúdo pode ser falsificado mina a credibilidade de todas as comunicações oficiais.

- Desafios à auditoria: a natureza automatizada e opaca dos algoritmos impede auditorias independentes, dificultando a responsabilização.

Além disso, a rapididade com que esses materiais são produzidos e disseminados cria um efeito cascata: um clip manipulado pode ser re‑postado milhares de vezes antes de que qualquer verificação seja concluída. O custo de criar um deepfake diminuiu significativamente com o advento de modelos generativos de código aberto, tornando a operação acessível até mesmo a atores menos especializados.

Embora a tecnologia ofereça novas possibilidades de engajamento, a ausência de marcos regulatórios específicos no Brasil implica que a própria estrutura de campanha pode ser explorada sem controle formal. A falta de exigência de registro de origem dos conteúdos gerados por IA significa que os eleitores podem ser expostos a mensagens de procedência incerta, sem saber se foram produzidas por um partido, por terceiros ou por agentes externos.

O caminho para mitigar esses riscos inclui o desenvolvimento de ferramentas de detecção automática que analisam inconsistências de iluminação, sincronização labial e artefatos de compressão, bem como a criação de mecanismos de verificação de procedência baseados em blockchain ou em assinaturas digitais. Contudo, a eficácia dessas soluções depende de colaboração entre plataformas digitais, partidos políticos, órgãos reguladores e sociedade civil.

Assim, a combinação de deepfakes e microsegmentação representa um ponto de virada para a política brasileira nas eleições de 2026. Enquanto a tecnologia avança, a resposta institucional deve priorizar a transparência, a auditoria de modelos de IA e a educação midiática para evitar que a desinformação se torne a nova moeda de troca nas urnas.

Desafios regulatórios e perspectivas futuras

O cenário regulatório brasileiro ainda carece de instrumentos específicos que tratam da utilização de inteligência artificial em processos eleitorais, sobretudo quando se trata de deepfakes e outras formas de manipulação digital. A ausência de legislação clara cria um vácuo que impede a fiscalização efetiva e dificulta a responsabilização de agentes que empregam essas tecnologias para fins políticos. Nesse contexto, a necessidade de frameworks de governança se torna imprescindível, pois permite estabelecer regras de transparência, exigir auditorias de modelos de IA e definir padrões de desempenho para evitar fraudes.

Uma das primeiras medidas propostas pelos especialistas é a criação de um registro obrigatório de modelos de IA utilizados em campanhas eleitorais. Esse registro deveria conter informações sobre a origem dos dados de treinamento, os algoritmos empregados, os parâmetros de hiperparâmetro e os principais indicadores de desempenho. A transparência nesse aspecto possibilitaria que órgãos como o Tribunal Superior Eleitoral (TSE) e entidades de fiscalização juntos com organizações da sociedade civil verifiquem a conformidade das soluções tecnológicas.

Além do registro, recomenda‑se a implementação de mecanismos de auditoria de modelos ao longo de todo o ciclo de vida da ferramenta. Auditorias independentes podem analisar se o algoritmo está livre de viés que favoreça determinados grupos de eleitores, bem como se as decisões geradas são interpretáveis e explicáveis. Essa prática cria um círculo virtuoso de accountability, reduzindo o risco de decisões automatizadas que impactem negativamente a competitividade da disputa política.

Outro ponto crítico refere‑se à prevenção de fraudes e manipulação de opinião pública. Para tanto, é necessário desenvolver e institucionalizar sistemas de detecção precoce de conteúdos falsos ou manipulados, combinando técnicas de visão computacional e processamento de linguagem natural. Parcerias entre universidades, startups de segurança digital e órgãos reguladores podem viabilizar plataformas de monitoramento em tempo real, que sinalizem possíveis violações assim que forem identificadas.

Em termos de políticas públicas, suger‑se a elaboração de normas de licenciamento específicas para o uso de IA em contextos eleitorais, que definam limites de uso, requisitos de consentimento e obrigações de divulgação de patrocinadores de conteúdo gerado por máquinas. Essas normas devem ser flexíveis o suficiente para se adaptarem às rápidas inovações tecnológicas, mas sólidas o bastante para garantir a integridade do processo democrático.

Por fim, a formação de capacidades institucionais é fundamental. O TSE, juntas com organizações da sociedade civil, deve investir em treinamento de analistas políticos e técnicos, criando equipes multidisciplinares aptas a analisar impactos regulatórios, avaliar riscos e propor ajustes legislativos. Essa abordagem proativa assegura que o Brasil esteja preparado para lidar com os desafios emergentes da IA nas campanhas eleitorais, promovendo um ambiente de campanha mais justo e seguro.

Table: Propostas regulatórias emergentes para o uso de IA em campanhas eleitorais

| Proposta | Objetivo | Prazo estimado |

|---|---|---|

| Registro obrigatório de modelos de IA | Transparência nos algoritmos empregados | 2026‑2027 |

| Auditoria independente de modelos | Verificar viés e aderência a padrões éticos | 2027‑2028 |

| Sistemas de detecção de deepfakes | Identificar conteúdo fraudulento em tempo real | 2026‑2029 |

Conclusão

A inteligência artificial está redefinindo o cenário político e será decisiva nas eleições de 2026, exigindo atenção regulatória e estratégias de comunicação responsáveis.

Deixe uma resposta